Qu'est-ce qu'OpenAI Sora et va-t-il changer la vidéo pour toujours ?

La vitesse de développement de l'IA dépasse la compréhension humaine, et le système texte-vidéo Sora d'OpenAI n'est que la dernière technologie d'IA à choquer le monde en lui faisant réaliser que les choses se produisent plus tôt que prévu.

Qu’est-ce qu’OpenAI Sora ?

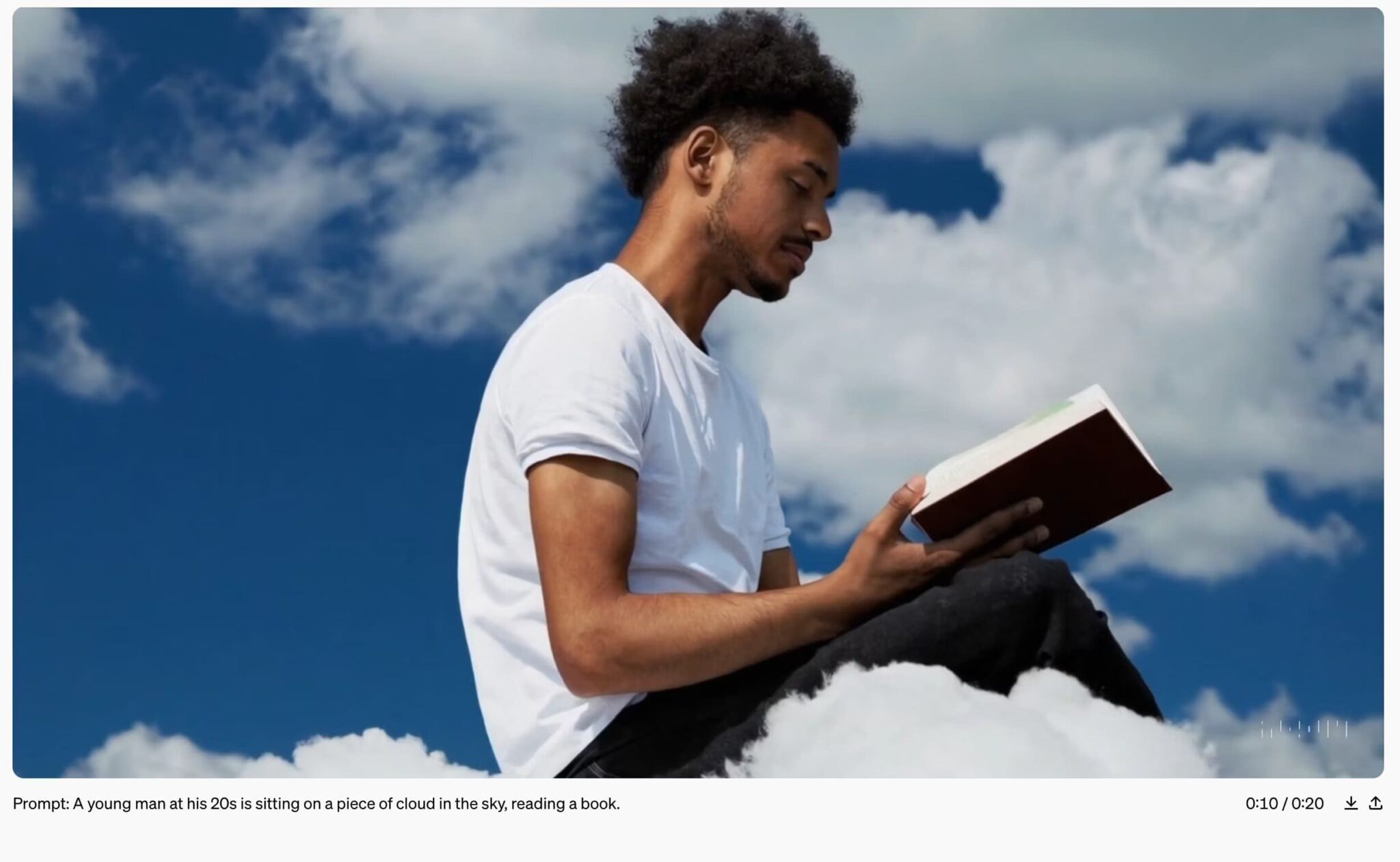

Comme d’autres outils d’IA générative comme DALL-E et MidJourney, Sora prend vos invites textuelles et les transforme en support visuel. Cependant, contrairement aux générateurs d'images alimentés par l'IA mentionnés ci-dessus, Sora crée une vidéo pleine de mouvement, différents angles de caméra, direction et tout ce que vous attendez d'une vidéo produite de manière traditionnelle.

En regardant les exemples sur Site Web de Sora, Les résultats sont souvent impossibles à distinguer des vidéos réelles produites par des professionnels. Tout, des images de drones de pointe aux productions cinématographiques de plusieurs millions de dollars. Complet avec des acteurs générés par l'IA, des effets spéciaux et les œuvres.

Bien entendu, Sora n’est pas la première technologie à faire cela. Le leader de loin le plus visible dans ce domaine a été PisteML, qui fournit ses services au public contre rémunération. Cependant, même dans le meilleur des cas, les vidéos de Runway sont plus proches des premières générations que les images fixes de MidJourney. Il n'y a pas de stabilisation d'image, la physique n'a pas de sens, et au moment où j'écris ces lignes, le clip le plus long dure 16 secondes.

En revanche, le meilleur résultat que Sora doit montrer est complètement stable, avec une physique qui semble correcte (au moins pour notre cerveau), et les clips peuvent durer jusqu'à une minute. Les clips sont totalement sans audio, mais il existe déjà d'autres systèmes d'IA capables de générer de la musique, des effets sonores et de la parole. Je n'ai donc aucun doute sur le fait que ces outils peuvent être intégrés au flux de travail de Sora ou, au pire, au travail traditionnel de voix off et de bruitage.

On ne peut pas sous-estimer l’énorme progrès que Sora représente par rapport aux séquences vidéo cauchemardesques d’IA d’un an seulement avant la démo de Sora. C'est très ennuyeux. Je pense que c’est un choc plus important pour le système que lorsque les générateurs d’images IA sont passés du statut de plaisanterie à celui d’inspirer une terreur existentielle aux artistes visuels.

Sora aura probablement un impact sur l'ensemble de l'industrie vidéo, depuis les créateurs de plans uniques jusqu'aux projets à gros budget de Disney et Marvel. Rien n’en sera affecté. Je pense que cela est particulièrement vrai puisque Sora n'a pas besoin de créer des choses à partir de tissu entier, mais peut travailler sur des matériaux existants, comme animer une image fixe que vous avez fournie. C’est peut-être le véritable début de la réalisation de films de synthèse.

Comment fonctionne Sora ?

Nous approfondirons le personnage de Sora autant que possible, mais il n'est pas possible d'entrer dans autant de détails. Premièrement, ironiquement, OpenAI n’est pas ouvert sur le fonctionnement interne de sa technologie. Il est exclusif, donc la sauce secrète qui distingue le Sora de la concurrence nous est inconnue dans ses moindres détails. Deuxièmement, je ne suis pas un informaticien, et peut-être que vous n’êtes pas un informaticien, nous ne pouvons donc comprendre le fonctionnement de cette technologie qu’en termes généraux.

La bonne nouvelle est qu'il existe une excellente présentation de Sora (paywalled) par Mike Young Sur Medium, basé sur Rapport technique d'OpenAI Ce qui a été détaillé pour que nous, simples humains, puissions le comprendre. Même si les deux documents valent la peine d’être lus, nous pouvons en extraire ici les faits les plus importants.

Sora s'appuie sur les leçons que des entreprises comme OpenAI ont apprises lors de la création de technologies comme ChatGPT ou DALL-E. Sora a innové dans la façon dont il a formé des exemples de vidéos en divisant ces vidéos en « patchs » similaires aux « jetons » utilisés par le modèle de formation ChatGPT. Étant donné que ces jetons ont tous la même taille, des éléments tels que la longueur du clip, le rapport hauteur/largeur et la taille de la résolution n'ont pas d'importance pour Sora.

Sora utilise la même approche large de transformateur qui alimente GPT ainsi que la méthode de propagation utilisée par les générateurs d'images IA. Pendant la formation, il examine les jetons de patch bruyants dispersés partiellement à partir d'une vidéo et tente de prédire à quoi ressemblerait un jeton sans bruit. En comparant cela à la vérité terrain, le modèle apprend le « langage » de la vidéo. C'est pourquoi les exemples du site Web de Sora semblent si originaux.

Outre cette capacité impressionnante, Sora dispose également d'annotations intégrées très détaillées pour les images vidéo sur lesquelles il s'est entraîné, ce qui explique en grande partie pourquoi il est capable d'éditer les vidéos qu'il crée en fonction d'invites textuelles.

La capacité de Sora à simuler avec précision la physique dans des vidéos semble être une fonctionnalité émergente, qui résulte simplement de sa formation sur des millions de vidéos contenant des mouvements basés sur la physique du monde réel. Sora possède une excellente stabilité des objets, de sorte que lorsqu'un objet quitte le cadre ou est obstrué par quelque chose d'autre dans le cadre, il y reste et revient sans aucune perturbation.

Cependant, des problèmes subsistent parfois lorsque les objets de la vidéo interagissent avec la causalité et avec la création automatique d'objets. Aussi, quelque peu drôle, Sora semble confondre gauche et droite de temps en temps. Cependant, ce qui a été démontré jusqu’à présent est non seulement réellement utilisable, mais aussi à la pointe de la technologie.

Quand auras-tu Sora ?

Nous sommes donc tous très excités de mettre la main à la pâte avec Sora, et vous pouvez parier le moins d'argent possible que je vais jouer avec et écrire exactement à quel point cette technologie est bonne quand elle ne nous montre pas de cerise sur le gâteau. sortie sélectionnée, mais quand cela pourrait-il arriver ?

Au moment d'écrire ces lignes, on ne sait pas exactement combien de temps il faudra avant que Sora ne soit disponible au grand public, ni combien cela coûtera. OpenAI a rapporté que la technologie est entre les mains de la « Red Team », un groupe de personnes dont le travail est d'essayer de faire faire à Sora toutes les mauvaises choses qu'il n'est pas censé faire, puis d'aider à mettre en place des garde-fous contre ce genre de choses. Cela se produit lorsque les clients réels peuvent l'utiliser. Cela inclut la possibilité de créer des informations trompeuses, de créer du matériel offensant ou offensant et de nombreuses autres violations imaginables.

Il est également, au moment d'écrire ces lignes, entre les mains de créateurs sélectionnés, ce qui, je crois, est à des fins de test et pour obtenir des critiques et des approbations de tiers alors que nous nous dirigeons vers sa sortie finale.

L'essentiel est que nous ne savons pas réellement quand il sera disponible, de la même manière que vous ne pouvez payer que pour utiliser DALL-E 3, et en fait même OpenAI n'a pas encore de date exacte. En effet, s'il est entre les mains de testeurs de sécurité, ils peuvent découvrir des problèmes qui prennent plus de temps à résoudre que prévu, ce qui retardera la publication publique.

Le fait qu'OpenAI se sente prêt à montrer Sora et même à recevoir des réclamations publiques coordonnées via la sécurité détectée, personne ne peut le dire avec certitude. Je pense que nous parlons de mois, pas d'années, mais ne vous attendez pas à cela la semaine prochaine.